在當今競爭激烈的商業環境中,企業形象已成為核心競爭力的重要組成部分。一套統一、專業、高品質的工裝,不僅是員工的身份標識,更是企業品牌文化、精神面貌和專業度的外在體現。專注于高中檔企業工裝的專業生產,正是為滿足現代企業提升形象、增強團隊凝聚力和保障員工職業需求的深度服務。

一、 專業定位:聚焦高中檔品質,滿足多元需求

專業生產并非簡單的服裝加工,而是基于對行業特性、企業文化和穿著場景的深刻理解。高中檔企業工裝的生產,嚴格把控從面料選擇到成品出廠的每一個環節:

- 面料考究:精選優質、舒適、耐用且功能性強的面料,如高支棉、功能性滌棉混紡、抗皺免燙面料等,確保服裝在長期穿著與頻繁洗滌后仍能保持挺括外形與舒適體感。

- 工藝精湛:采用先進的裁剪與縫制工藝,注重細節處理,如線跡工整、扣件牢固、接縫平整。針對不同行業(如酒店、金融、制造、物業等)的工作特性,可能融入反光條、多功能口袋、透氣網眼等專業設計。

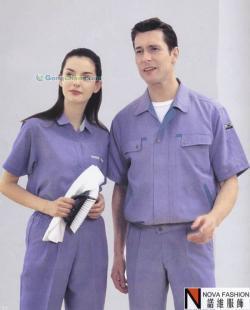

- 設計專業:結合企業VI(視覺識別系統),在款式、色彩、徽標繡印/燙印上進行個性化定制。設計風格兼顧職業感、時尚度與實用性,使工裝既能彰顯行業屬性,又能貼合當代審美,提升員工穿著意愿。

二、 核心價值:超越服裝本身的企業賦能

- 統一品牌形象:統一的工裝是行走的品牌廣告,能向客戶和公眾傳遞出規范、可靠、專業的正面信號,增強品牌識別度與信任感。

- 增強團隊歸屬感:工裝是“團隊皮膚”,能有效消除員工間的著裝差異,促進平等感與集體認同,強化“我們是一體”的團隊精神。

- 提升職業素養與安全感:合體、專業的著裝能潛移默化地規范員工行為,提升其職業自豪感與責任感。對于特定行業,具備防護功能的工裝更是安全生產的重要保障。

- 簡化管理,降低成本:為企業提供從設計、量體、生產到配送的一站式服務,省去企業分散采購的繁瑣。高品質的工裝更耐穿,長期來看降低了頻繁更換的采購成本。

三、 服務平臺:對接“世界工廠網”等B2B平臺,拓寬市場渠道

在數字化采購時代,專業生產商積極利用如“世界工廠網中國產品信息庫”這類大型B2B電子商務平臺。通過平臺:

- 展示實力:詳細展示企業資質、生產設備、成功案例、產品樣冊及面料信息,建立專業可信的線上形象。

- 精準獲客:平臺匯聚了海量有工裝采購需求的企業客戶,便于生產商觸達目標客戶群體,實現精準營銷。

- 高效溝通:提供便捷的詢價、溝通工具,促進供需雙方高效對接,縮短交易鏈路。

- 信任背書:依托平臺的知名度和信用體系,更容易獲得跨區域新客戶的初步信任。

高中檔企業工裝的專業生產,是一門融合了服裝工藝、企業管理和品牌營銷的綜合學問。它輸出的不僅是遮體御寒的服飾,更是一種企業軟實力。選擇一家專業的生產供應商,意味著選擇了一位深度理解企業需求、助力品牌形象建設的戰略伙伴。在“世界工廠網”這類信息匯聚的平臺上,專業生產者正以其卓越的品質與服務,為各行各業的企業團隊打造值得信賴的職業戰袍,共同塑造更加規范、專業、和諧的商業風景線。